Diferença entre o Apache Hive e o Apache Spark SQL

Com a enorme quantidade de aumento das tecnologias de big data atualmente, está se tornando muito importante usar a ferramenta certa para todos os processos. O processo pode ser qualquer coisa como ingestão de dados, processamento de dados, recuperação de dados, armazenamento de dados etc. Neste post, leremos sobre duas dessas ferramentas de recuperação de dados, Apache Hive e Apache Spark SQL. O Hive, por um lado, é conhecido por seu processamento eficiente de consultas, usando HQL (Hive Query Language) semelhante a SQL e é usado para dados armazenados no Hadoop Distributed File System, enquanto o Spark SQL faz uso da linguagem de consulta estruturada e garante que todos as operações online de leitura e gravação são atendidas. O Hive é conhecido por ser o componente do ecossistema de Big Data, onde mapeadores e redutores herdados são necessários para processar dados do HDFS, enquanto o Spark SQL é conhecido por ser o componente da API Apache Spark, que tornou o processamento no ecossistema de Big Data muito mais fácil e real -Tempo. Um grande equívoco que a maioria dos profissionais atualmente possui é que o hive só pode ser usado com tecnologia e ferramentas de big data herdadas, como PIG, HDFS, Sqoop, Oozie. Essa afirmação não é completamente verdadeira, pois o Hive é compatível não apenas com as ferramentas herdadas, mas também com outros componentes baseados no Spark, como o Spark Streaming. A idéia por trás de usá-los é reduzir o esforço e trazer melhores resultados para os negócios. Vamos estudar sobre o Apache Hive e o Apache Spark SQL em detalhes.

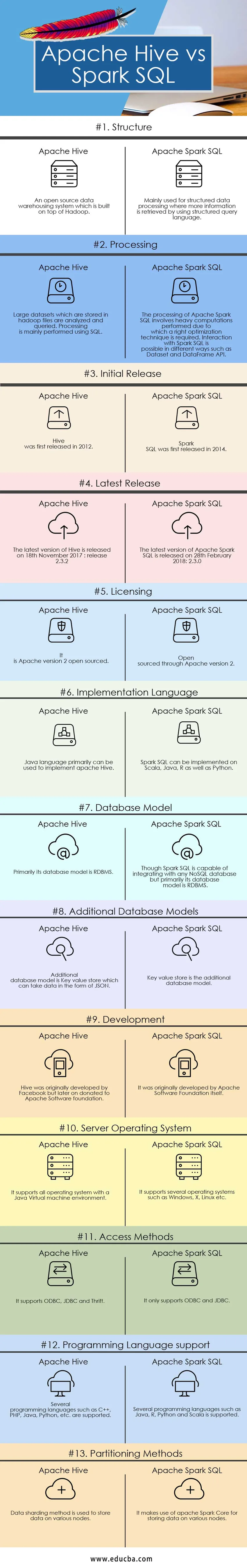

Comparação cara a cara entre Apache Hive x Apache Spark SQL (Infográficos)

Abaixo está a comparação dos 13 principais entre Apache Hive e Apache Spark SQL

Principais diferenças entre Apache Hive e Apache Spark SQL

Principais diferenças entre Apache Hive e Apache Spark SQL

As diferenças entre o Apache Hive e o Apache Spark SQL são discutidas nos pontos mencionados abaixo:

- O Hive é conhecido por usar o HQL (Hive Query Language), enquanto o Spark SQL é conhecido por fazer uso da linguagem de consulta estruturada para processamento e consulta de dados

- O Hive fornece flexibilidade de esquema, dividindo e distribuindo as tabelas, enquanto o Spark SQL executa consultas SQL, apenas é possível ler dados da instalação existente do Hive.

- O Hive fornece direitos de acesso para usuários, funções e grupos, enquanto o Spark SQL não fornece nenhum recurso para fornecer direitos de acesso a um usuário.

- O Hive fornece o recurso de fator de replicação seletivo para armazenamento redundante de dados, enquanto o spark SQL, por outro lado, não fornece nenhum fator de replicação para o armazenamento de dados.

- Como os drivers JDBC, ODBC e thrift estão disponíveis no Hive, podemos usá-los para gerar resultados, enquanto que no Apache Spark SQL podemos recuperar resultados na forma de conjuntos de dados e APIs DataFrame se o Spark SQL for executado com outra linguagem de programação.

- Existem várias limitações:

- Atualizações em nível de linha e consultas OLTP em tempo real não são possíveis usando o Apache Hive, enquanto atualizações em nível de linha e processamento de transações online em tempo real são possíveis usando o Spark SQL.

- Fornece alta latência aceitável para navegação interativa de dados, enquanto no Spark SQL a latência fornecida é até o mínimo para aprimorar o desempenho.

- O Hive, como instruções e consultas SQL, suporta o tipo UNION, enquanto o Spark SQL é incapaz de suportar o tipo UNION.

Tabela de comparação entre Apache Hive e Apache Spark SQL

| Base de comparação | Apache Hive | Apache Spark SQL |

| Estrutura | Um sistema de data warehouse de código aberto, construído sobre o Hadoop | Usado principalmente para processamento de dados estruturados, onde mais informações são recuperadas usando a linguagem de consulta estruturada. |

| Em processamento | Grandes conjuntos de dados armazenados em arquivos hadoop são analisados e consultados. O processamento é realizado principalmente usando SQL. | O processamento do Apache Spark SQL envolve cálculos pesados realizados devido aos quais é necessária uma técnica de otimização correta. A interação com o Spark SQL é possível de diferentes maneiras, como Dataset e DataFrame API. |

| lançamento inicial | Hive foi lançado pela primeira vez em 2012 | Spark SQL foi lançado pela primeira vez em 2014 |

| Último lançamento | A versão mais recente do Hive foi lançada em 18 de novembro de 2017: release 2.3.2 | A versão mais recente do Apache Spark SQL foi lançada em 28 de fevereiro de 2018: 2.3.0 |

| Licenciamento | É Apache versão 2 de código aberto | Origem aberta através do Apache versão 2 |

| Linguagem de implementação | A linguagem Java principalmente pode ser usada para implementar o apache Hive | O Spark SQL pode ser implementado em Scala, Java, R e Python |

| Modelo de banco de dados | Principalmente seu modelo de banco de dados é RDBMS | Embora o Spark SQL seja capaz de integrar-se a qualquer banco de dados NoSQL, mas principalmente seu modelo de banco de dados é RDBMS |

| Modelos de banco de dados adicionais | O modelo de banco de dados adicional é um armazenamento de valor-chave que pode receber dados na forma de JSON | O armazenamento de valores-chave é o modelo de banco de dados adicional |

| Desenvolvimento | O Hive foi originalmente desenvolvido pelo Facebook, mas posteriormente doado para a Apache Software Foundation | Foi originalmente desenvolvido pela própria Apache Software Foundation |

| Sistema operacional do servidor | Ele suporta todos os sistemas operacionais com um ambiente de máquina virtual Java | Ele suporta vários sistemas operacionais, como Windows, X, Linux etc. |

| Métodos de acesso | Ele suporta ODBC, JDBC e Thrift | Ele suporta apenas ODBC e JDBC |

| Suporte à linguagem de programação | Várias linguagens de programação como C ++, PHP, Java, Python, etc. são suportadas | Várias linguagens de programação como Java, R, Python e Scala são suportadas |

| Métodos de particionamento | O método de compartilhamento de dados é usado para armazenar dados em vários nós | Utiliza o Apache Spark Core para armazenar dados em vários nós |

Conclusão - Apache Hive vs Apache Spark SQL

Não podemos dizer que o Apache Spark SQL seja o substituto do Hive ou vice-versa. Só que o Spark SQL pode ser visto como uma API baseada no Spark, que é amigável ao desenvolvedor, que visa facilitar a programação. O Hive tem sua capacidade especial de alternar frequentemente entre os mecanismos e, portanto, é uma ferramenta eficiente para consultar grandes conjuntos de dados. O uso e implementação sobre o que escolher depende de suas metas e requisitos. O Apache Hive e o Apache Spark SQL são jogadores em seu próprio campo. Espero que, depois de ler o post, você tenha uma idéia suficientemente justa sobre a necessidade de sua organização. Siga o nosso blog para mais postagens como essas e garantimos que fornecemos informações que promovam seus negócios.

Artigo recomendado

Este foi um guia do Apache Hive vs Apache Spark SQL, seu significado, comparação cara a cara, diferenças principais, tabela de comparação e conclusão. Você também pode consultar os seguintes artigos para saber mais -

- Diferenças Java vs Node JS

- Apache Pig vs Apache Hive - As 12 principais diferenças úteis

- Hadoop vs Hive - Descubra as melhores diferenças

- 7 coisas úteis importantes sobre o Apache Spark (Guia)

- Apache Hadoop vs Apache Spark | As 10 melhores comparações que você deve saber!

- Usando a função ORDER BY no Hive