Introdução à regressão linear simples

Do dicionário : um retorno a um estado anterior ou menos desenvolvido.

Em estatística: uma medida da relação entre o valor médio de uma variável e os valores correspondentes das outras variáveis.

A regressão, na qual a relação entre a variável de entrada (variável independente) e a variável de destino (variável dependente) é considerada linear é chamada de regressão linear. A regressão linear simples é um tipo de regressão linear em que temos apenas uma variável independente para prever a variável dependente. A regressão linear simples é um dos algoritmos de aprendizado de máquina. A regressão linear simples pertence à família de Aprendizado Supervisionado. A regressão é usada para prever valores contínuos.

Modelo de regressão linear simples

Vamos simplificar. Como tudo começou?

Tudo começou em 1800 com Francis Galton. Ele estudou o relacionamento em altura entre pais e filhos. Ele observou um padrão: a altura do filho seria tão alta quanto a altura do pai ou a altura do filho tenderia a estar mais próxima da altura média geral de todas as pessoas. Esse fenômeno não passa de regressão.

Por exemplo, Shaq O'Neal é um jogador da NBA muito famoso e tem 2, 16 metros de altura. Seus filhos Shaqir e Shareef O'neal têm 1, 96 metros e 2, 06 metros de altura, respectivamente. A altura média da população é de 1, 76 metros. A altura do filho regride (deriva em direção) à altura média.

Como fazemos regressão?

Calculando uma regressão com apenas dois pontos de dados:

Tudo o que queremos fazer para encontrar a melhor regressão é desenhar uma linha o mais próximo possível de cada ponto. No caso de dois pontos de dados, é fácil desenhar uma linha, basta uni-los.

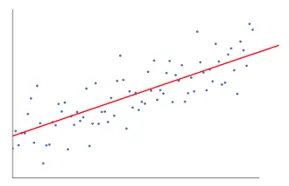

Agora, se estamos tendo um número de pontos de dados agora, como desenhar a linha o mais próximo possível de cada ponto de dados.

Nesse caso, nosso objetivo é minimizar a distância vertical entre a linha e todos os pontos de dados. Dessa forma, prevemos a melhor linha para o nosso modelo de regressão linear.

O que é uma regressão linear simples?

Abaixo está a explicação detalhada da regressão linear simples:

- Desenha muitas e muitas linhas de linhas possíveis e, em seguida, faz qualquer uma dessas análises.

- Soma dos erros ao quadrado.

- Soma dos erros absolutos.

- método do quadrado mínimo … etc

- Para nossa análise, usaremos o método dos mínimos quadrados.

- Faremos a diferença de todos os pontos e calcularemos o quadrado da soma de todos os pontos. Qualquer linha que der a soma mínima será a nossa melhor linha.

Por exemplo: Ao fazer isso, podemos ter vários homens e a altura do filho e fazer coisas como dizer a um homem qual a altura dele. antes mesmo de ele nascer.

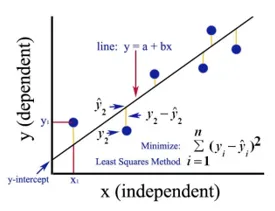

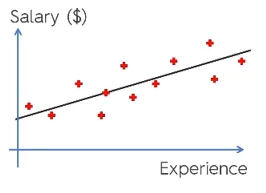

imagem do Google

A figura acima mostra uma regressão linear simples. A linha representa a linha de regressão. Dado por: y = a + b * x

Onde y é a variável dependente (DV): Por exemplo, como o salário de uma pessoa muda dependendo do número de anos de experiência que o funcionário possui. Portanto, aqui o salário de um funcionário ou pessoa será sua variável dependente.

A variável dependente é a nossa variável alvo, a que queremos prever usando regressão linear.

x é a nossa variável independente (IV): A variável dependente é a causa da variável independente de alteração. No exemplo acima, o número de anos de experiência é nossa variável dependente, porque o número de anos de experiência está causando a alteração no salário do funcionário.

- b é a variável de coeficiente para nossa variável independente x. Esse coeficiente desempenha um papel crucial. Diz como uma mudança de unidade em x (IV) afetará y (DV). É referido como o coeficiente de proporcional também. Em termos de matemática, depende de você a inclinação da linha, ou você pode dizer que é íngreme da linha.

- Em nosso exemplo, se a inclinação (b) for menor, o que significa que o número de anos produzirá menos incremento no salário, por outro lado, se a inclinação (b) for maior, produzirá um aumento alto no salário com um aumento no número de anos de experiência.

- a é um valor constante. É também chamado de interceptação, é onde a linha está cruzando o eixo y ou o eixo DV. De outra maneira, podemos dizer que quando um funcionário tem zero anos de experiência (x), o salário (y) para esse funcionário será constante (a).

Como funciona a Least Square?

Abaixo estão os pontos para o trabalho menos quadrado:

- Ele desenha uma linha arbitrária de acordo com as tendências de dados.

- Ele pega pontos de dados e desenha linhas verticais. Considera a distância vertical como um parâmetro.

- Essas linhas verticais cortam a linha de regressão e fornecem o ponto correspondente para os pontos de dados.

- Ele encontrará a diferença vertical entre cada ponto de dados e seu ponto de dados correspondente na linha de regressão.

- Ele calculará o erro que é o quadrado da diferença.

- Em seguida, calcula a soma dos erros.

- Então, novamente, ele desenhará uma linha e repetirá o procedimento acima novamente.

- Ele desenha um número de linhas dessa maneira e a linha que dá a menor soma de erros é escolhida como a melhor linha.

- Essa melhor linha é a nossa linha de regressão linear simples.

Aplicação de regressão linear simples

A análise de regressão é realizada para prever a variável contínua. A análise de regressão tem uma grande variedade de aplicações. Alguns exemplos são os seguintes:

- Análise preditiva

- Eficácia do marketing,

- preços de qualquer listagem

- previsão de promoção para um produto.

Aqui vamos discutir uma aplicação de regressão linear para análise preditiva. Faremos modelagem usando python.

Os passos que seguiremos para construir nosso modelo são os seguintes:

- Importaremos as bibliotecas e os conjuntos de dados.

- Pré-processaremos os dados.

- Dividiremos os dados no conjunto de testes e no conjunto de treinamento.

- Criaremos um modelo que tentará prever a variável alvo com base em nosso conjunto de treinamento

- Vamos prever a variável de destino para o conjunto de testes.

- Analisaremos os resultados previstos pelo modelo

Para nossa análise, usaremos um conjunto de dados salariais com os dados de 30 funcionários.

# Importando as bibliotecas

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

# Importando o conjunto de dados (a amostra de dados é mostrada na tabela)

dataset = pd.read_csv('Salary_Data.csv')

| anos de experiência | Salário |

| 1.5 | 37731 |

| 1.1 | 39343 |

| 2.2 | 39891 |

| 2 | 43525 |

| 1.3 | 46205 |

| 3.2. | 54445 |

| 4 | 55749 |

# Pré-processando o conjunto de dados, aqui vamos dividir o conjunto de dados na variável dependente e na variável independente. x como independente e y como variável dependente ou de destino

X = dataset.iloc(:, :-1).values

y = dataset.iloc(:, 1).values

# Dividindo o conjunto de dados no conjunto de treinamento e no conjunto de testes:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 1/3, random_state = 0)

Aqui, o tamanho do teste 1/3 mostra que, do total de dados, 2/3 parte é para treinar o modelo e o restante 1/3 é usado para testar o modelo.

# Vamos ajustar nosso modelo de regressão linear simples ao conjunto de treinamento

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, y_train)

O modelo de regressão linear é treinado agora. Este modelo será usado para prever a variável dependente.

# Prevendo os resultados do conjunto de testes

y_pred = regressor.predict(X_test)

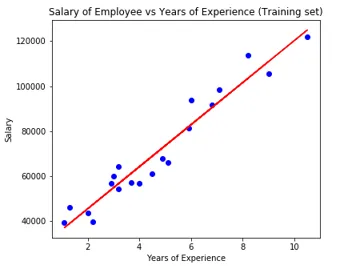

# Visualizando os resultados do conjunto de testes

plt.scatter(X_test, y_test, color = 'blue')

plt.plot(X_train, regressor.predict(X_train), color = 'red')

plt.title('Salary of Employee vs Experience (Test set)')

plt.xlabel('Years of Experience')

plt.ylabel('Salary')

plt.show()

# Parâmetro do modelo

print(regressor.intercept_)

print(regressor.coef_)

26816.19224403119

(9345.94244312)

Portanto, o valor do interceptor (a) é 26816. O que sugere que qualquer atualização (experiência zero) estaria recebendo cerca de 26816 em salário.

O coeficiente para o nosso modelo saiu como 9345.94. Ele sugere que, mantendo todos os outros parâmetros constantes, a mudança em uma unidade da variável independente (anos de exp.) Trará uma mudança de 9345 unidades no salário.

Métricas de avaliação de regressão

Existem basicamente três métodos importantes de métricas de avaliação disponíveis para análise de regressão:

- Erro absoluto médio (MAE): mostra a média dos erros absolutos, que é a diferença entre o previsto e o real.

- Mean Squared Error (MSE): Mostra o valor médio dos erros ao quadrado.

- Erro médio quadrático da raiz (RMSE): Mostra a raiz quadrada da média dos erros quadráticos.

Podemos comparar os métodos acima:

- MAE: Mostra o erro médio e o mais fácil dos três métodos.

- MSE: este é mais popular que o MAE porque aprimora os erros maiores, o que, como resultado, mostra mais informações.

- RMSE: Este é melhor que o MSE, porque podemos interpretar o erro em termos de y.

Esses 3 nada mais são do que funções de perda.

# Avaliação do modelo

from sklearn import metrics

print('MAE:', metrics.mean_absolute_error(y_test, y_pred))

print('MSE:', metrics.mean_squared_error(y_test, y_pred))

print('RMSE:', np.sqrt(metrics.mean_squared_error(y_test, y_pred)))

MAE: 3426.4269374307123

MSE: 21026037.329511296

RMSE: 4585.4157204675885

Conclusão

A análise de regressão linear é uma ferramenta poderosa para algoritmos de aprendizado de máquina, usada para prever variáveis contínuas como salário, vendas, desempenho etc. A regressão linear considera a relação linear entre variáveis independentes e dependentes. A regressão linear simples possui apenas uma variável independente com base na qual o modelo prevê a variável de destino. Discutimos o modelo e a aplicação da regressão linear com um exemplo de análise preditiva para prever o salário dos funcionários.

Artigos recomendados

Este é um guia para a regressão linear simples. Aqui discutimos o modelo e a aplicação da regressão linear, usando um exemplo de análise preditiva para prever os salários dos funcionários. Você também pode consultar nossos outros artigos relacionados para saber mais.

- Análise de regressão linear

- Regressão linear em R

- Modelagem de Regressão Linear

- Ferramentas de Teste de Regressão

- Matplotlib em Python | Top 14 Terrenos em Matplotlib

- Dicionário em Python | Métodos e Exemplos

- Exemplos de raiz quadrada em PHP

- Regressão linear vs regressão logística | Principais diferenças